引言:为什么选择本地部署大模型?

在数据隐私日益重要的今天,云端AI服务的局限性逐渐显现——敏感信息泄露风险、网络延迟依赖、定制化能力不足。而通过**Ollama(模型管理框架)和OpenWebUI(可视化交互工具)**的组合,开发者可以轻松实现大模型(如DeepSeek-R1)的本地部署,兼顾性能与安全。本文将以DeepSeek-R1为例,详解从环境配置到实战应用的全流程。

一、工具与模型简介

1. Ollama:轻量级模型管理引擎

核心功能:一键下载、运行和管理开源大模型,支持模型版本切换和量化压缩。

优势:跨平台(Windows/macOS/Linux)、无GPU依赖(CPU模式可用)、命令行友好。

2. OpenWebUI:类ChatGPT的交互界面

核心功能:提供Web端对话界面,支持多模型切换、对话历史管理、Markdown渲染。

优势:开源免费、支持Docker容器化部署、可扩展插件系统。

3. DeepSeek-R1:国产多模态大模型

特性:擅长代码生成、逻辑推理、中英文翻译,提供7B/32B/72B参数版本。

适用场景:企业知识库问答、自动化脚本编写、数据分析报告生成。

二、部署环境准备

操作系统:Windows 10+/macOS 12+/Ubuntu 20.04+

硬件配置:

7B/8B 模型:至少8GB内存 + 4GB显存(NVIDIA GTX 1060+)

32B模型:推荐24GB显存(如RTX 4090)

671B满血模型:尽可能多的A100!!!

网络要求:需访问GitHub/Docker Hub(建议配置代理或镜像加速)

三、详细部署流程

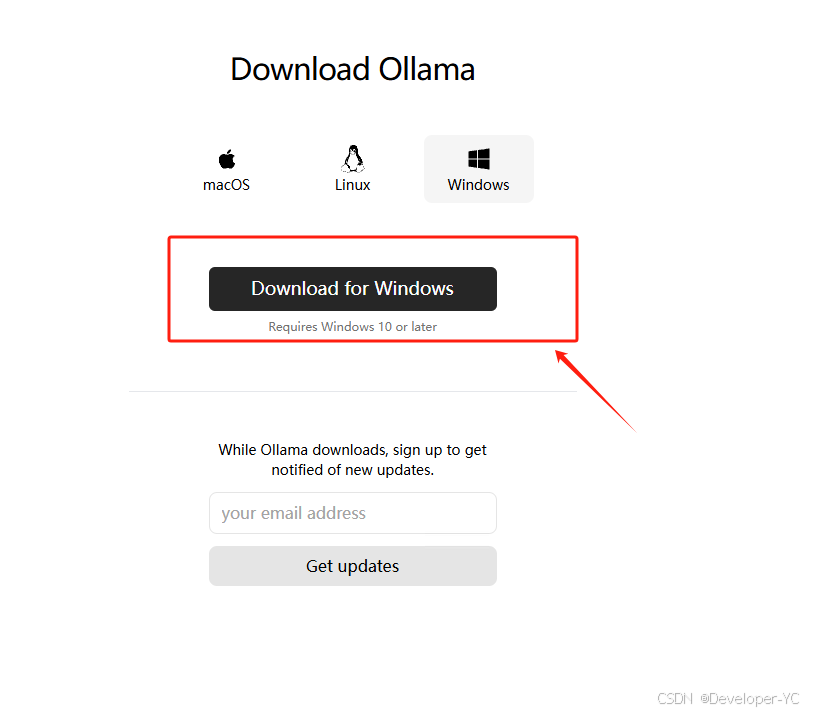

Step 1:安装Ollama

下载安装包:

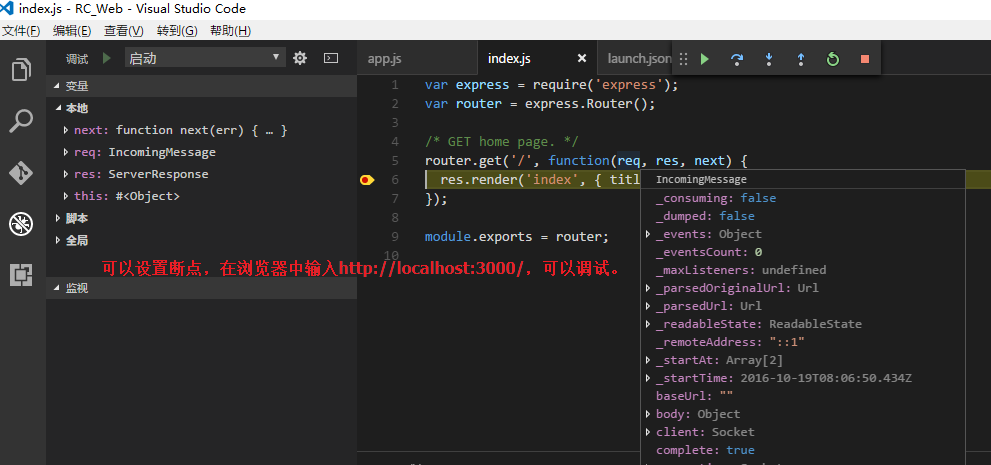

验证安装:

ollama --version # 输出版本号(如0.1.25)

配置环境变量:

模型存储:OLLAMA_MODELS 设置大模型存储地址(如:F:\ai-model)

主机参数:OLLAMA_HOST 建议设置为:0.0.0.0,方便域内访问

ps: 更多环境变量参数可直接访问GitHub开源地址查询