文章目录

- 一、引言

- 二、Node.js 文件操作基础 API

- 2.1 fs 模块的引入

- 2.2 文件的增删改查操作

- 2.2.1 创建文件与目录

- 2.2.2 读取文件与目录

- 2.2.3 文件的重命名与移动

- 2.2.4 删除文件与目录

- 三、Node.js 文件流操作核心要点

- 3.1 流的基本概念与类型

- 3.1.1 流是什么

- 3.1.2 流的类型

- 3.2 创建与使用读取文件流

- 3.2.1 创建读取流

- 3.2.2 监听读取流事件

- 3.3 创建与使用写入文件流

- 3.3.1 创建写入流

- 3.3.2 写入数据与背压处理

- 3.4 管道流:高效的数据传输

- 四、综合案例实战

- 4.1 大文件分块处理与合并

- 4.2 多文件整合与数据分析

- 五、总结与拓展

一、引言

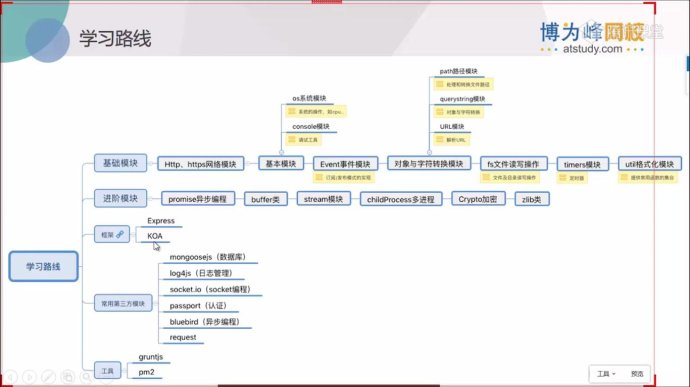

在前端开发的广阔天地中,Node.js 无疑是一颗璀璨的明星。它打破了 JavaScript 只能在浏览器环境运行的局限,为前端开发者开启了一扇通往服务器端编程的大门,极大地拓展了前端开发的边界。从构建高效的开发工具链,到实现前后端同构开发,再到助力桌面应用开发,Node.js 的身影无处不在,已然成为现代前端开发不可或缺的核心力量。

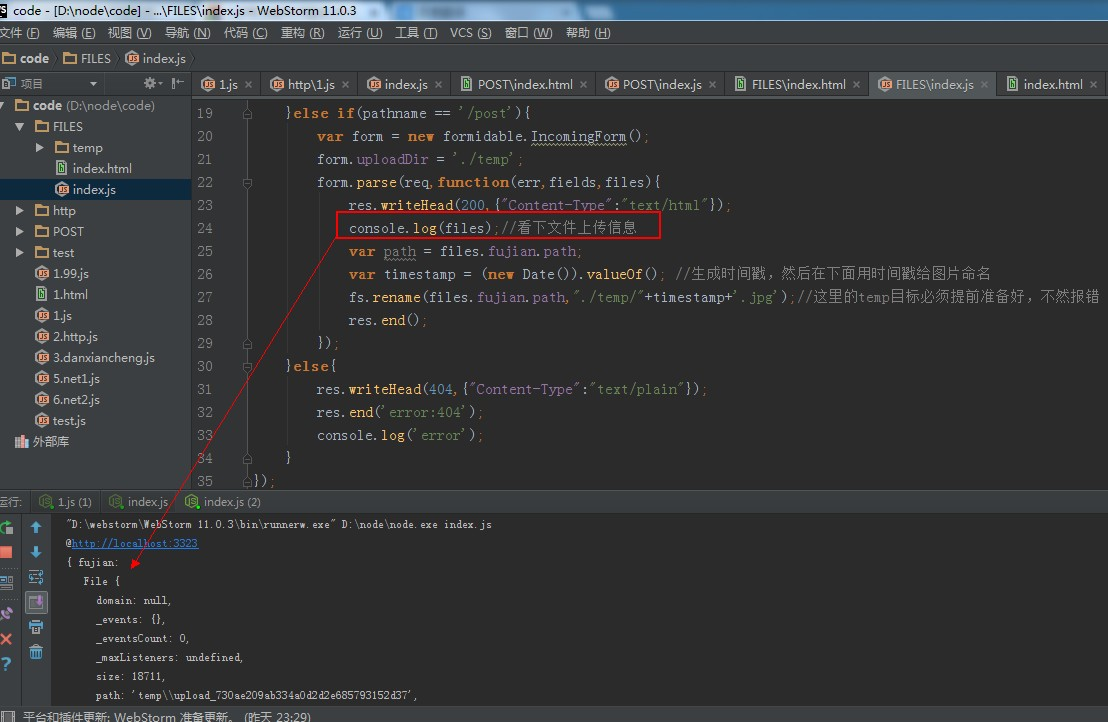

而在众多 Node.js 的应用场景里,文件及文件流操作犹如基石般重要。无论是处理日常的配置文件读取、日志记录,还是应对诸如大文件上传、下载,实时数据传输等复杂任务,精准且高效地操作文件及驾驭文件流都是关键所在。掌握这些知识,不仅能优化前端项目的性能,提升用户体验,更能让开发者在面对各种复杂需求时游刃有余,解锁更多创新的可能性。接下来,就让我们一同深入探索 Node.js 中文件及文件流操作的奇妙世界。

二、Node.js 文件操作基础 API

2.1 fs 模块的引入

在 Node.js 中,对文件进行操作离不开 fs 模块,它就像是一把万能钥匙,为我们开启通往文件系统的大门。使用时,只需简单地通过 const fs = require(‘fs’); 引入,无需额外安装,这是因为它是 Node.js 的核心模块,与生俱来就具备强大的文件处理能力,随时待命供开发者调用。

2.2 文件的增删改查操作

2.2.1 创建文件与目录

创建文件可以使用 fs.writeFile 方法,它的语法为 fs.writeFile(file, data[, options], callback)。其中,file 是要创建或写入的文件名(包含路径),data 是要写入的内容,options 是一些可选参数,如编码格式等,callback 则是操作完成后的回调函数。例如:

const fs = require('fs'); fs.writeFile('test.txt', '这是一个新创建的文件', (err) => { if (err) throw err; console.log('文件创建成功'); });上述代码就会在当前目录下创建一个名为 test.txt 的文件,并写入指定内容。若文件已存在,默认会覆盖原有内容。

创建目录则依靠 fs.mkdir 方法,语法为 fs.mkdir(path[, options], callback)。path 是要创建的目录路径,options 可以设置目录权限等,callback 用于反馈创建结果。像这样:

const fs = require('fs'); fs.mkdir('newDir', (err) => { if (err) throw err; console.log('目录创建成功'); });这段代码就能成功创建一个名为 newDir 的新目录。需要注意的是,如果要创建多层嵌套目录,在较新版本的 Node.js 中,可以传入 { recursive: true } 选项,实现递归创建,避免繁琐的逐层创建操作。

2.2.2 读取文件与目录

读取文件内容使用 fs.readFile 方法,语法为 fs.readFile(path[, options], callback)。path 指明要读取的文件路径,options 可指定编码格式,若不指定,读取到的数据是 Buffer 类型,callback 中的参数用于接收读取结果和可能出现的错误信息。示例如下:

const fs = require('fs'); fs.readFile('test.txt', 'utf8', (err, data) => { if (err) throw err; console.log(data); });这里会以 utf8 编码读取 test.txt 文件内容并打印出来。若不传入 utf8,可通过 data.toString() 将 Buffer 数据转换为字符串查看。

读取目录下的内容使用 fs.readdir 方法,语法是 fs.readdir(path[, options], callback)。path 为要读取的目录路径,callback 中的参数返回一个包含目录下所有文件和子目录名称的数组。比如:

const fs = require('fs'); fs.readdir('.', (err, files) => { if (err) throw err; console.log(files); });此代码将列出当前目录下的所有文件和子目录名称,方便我们快速了解目录结构。

2.2.3 文件的重命名与移动

fs.rename 方法可实现文件的重命名与移动,语法为 fs.rename(oldPath, newPath, callback)。oldPath 是原文件路径,newPath 是新路径,既可以是新文件名,实现重命名;也可以是不同目录下的路径,达成移动文件的目的,callback 用于处理操作结果。看下面的例子:

const fs = require('fs'); // 重命名文件 fs.rename('oldName.txt', 'newName.txt', (err) => { if (err) throw err; console.log('文件重命名成功'); }); // 移动文件 fs.rename('sourceDir/file.txt', 'targetDir/file.txt', (err) => { if (err) throw err; console.log('文件移动成功'); });上述代码分别展示了重命名文件和将文件从一个目录移动到另一个目录的操作,简单且高效。

2.2.4 删除文件与目录

删除文件使用 fs.unlink 方法,语法为 fs.unlink(path, callback),传入要删除的文件路径和回调函数,回调函数用于处理可能出现的错误。例如:

const fs = require('fs'); fs.unlink('test.txt', (err) => { if (err) throw err; console.log('文件删除成功'); });这段代码就能顺利删除指定的 test.txt 文件。

删除目录则要用到 fs.rmdir 方法,语法为 fs.rmdir(path, callback)。不过要特别注意,该方法只能删除空目录,如果目录非空,需要先清空目录下的文件和子目录。示例如下:

const fs = require('fs'); fs.rmdir('emptyDir', (err) => { if (err) throw err; console.log('空目录删除成功'); });通过以上这些基础 API,我们已经能够初步驾驭 Node.js 中的文件操作,实现日常开发中的基本需求。后续我们还会深入探索更高级的用法,进一步提升文件处理的能力。

三、Node.js 文件流操作核心要点

3.1 流的基本概念与类型

3.1.1 流是什么

流(Stream),在 Node.js 中宛如一条灵动的数据 “河流”。想象一下,数据不再是生硬地整块搬运,而是如同水流,潺潺地、连续不断地从一个源头流向目的地。就好比你打开水龙头,水会源源不断地流出,直到你关闭水龙头;在计算机世界里,流就是这样一种机制,数据从数据源(如文件、网络套接字等)一点一点地流向数据消费者(可能是另一个文件、网络请求的接收端,或是需要处理数据的程序模块),期间无需等待所有数据都准备好,边流动边处理,极大地提高了效率,避免了大量数据一次性加载带来的内存压力,让数据处理变得更加流畅、高效。

3.1.2 流的类型

Node.js 为我们精心准备了 4 种基本的流类型,每一种都各司其职,应对不同的数据处理场景。

- 可读流(Readable Stream):这是数据的 “源头”,专门负责从数据源读取数据,就像一口源源不断涌出泉水的泉眼。常见的应用场景便是读取文件内容,像我们使用 fs.createReadStream 方法就能轻松打开一个文件的可读流,让文件中的数据缓缓流出,以供后续处理。例如,当我们需要解析一个大型的日志文件时,通过可读流逐行读取数据,能避免一次性将整个文件加载到内存,有效防止内存溢出。

- 可写流(Writable Stream):与可读流相对应,它是数据的 “归宿”,负责将数据写入目标。例如使用 fs.createWriteStream 可以向文件写入数据,将我们想要保存的信息一点一点地存储起来。比如在记录系统运行日志时,可写流就能实时地把日志信息追加到日志文件中,确保数据的持久化存储。

- 双工流(Duplex Stream):兼具可读与可写的能力,如同一条双向通行的道路,数据既能流入又能流出。典型的例子就是网络通信中的 net.Socket,它允许服务器与客户端之间相互发送和接收数据,实现实时的双向交互,既可以读取对方发送过来的消息,又能将自己的响应写回给对方。

- 转换流(Transform Stream):这是一种特殊的双工流,它在数据流动的过程中像一位神奇的魔法师,对数据进行加工或转换。比如说在数据压缩场景中,使用 zlib.createDeflate 创建的转换流,能将输入的数据实时压缩后再输出,有效节省存储空间和传输带宽;又或者在加密场景下,对敏感数据进行加密转换,保障数据安全,让数据以全新的、更适合需求的形式向下游流动。

这四种流类型相互配合,构建起了 Node.js 强大而灵活的数据处理流水线,能够应对各式各样复杂的数据交互需求。

3.2 创建与使用读取文件流

3.2.1 创建读取流

在 Node.js 中,使用 fs.createReadStream 方法就能轻松搭建起一座连接文件与程序的数据 “桥梁”—— 读取流。它的语法为 fs.createReadStream(path[, options]),其中 path 参数明确指定了要读取的文件路径,这是找到数据源头的关键线索。而 options 参数则像是一个功能丰富的 “配置工具箱”,包含了诸多可定制的选项:

- encoding:用于设定读取数据的编码格式,常见的有 utf8、base64 等。若不指定,读取到的数据将以 Buffer 类型呈现,这是 Node.js 处理二进制数据的得力助手,不过对于文本文件,我们通常会根据文件的编码设置相应的 encoding,方便直接处理文本内容。

- autoClose:一个贴心的小开关,默认值为 true,意味着当读取流结束(无论是正常读完文件,还是遇到错误)时,会自动关闭对应的文件描述符,释放系统资源;若设置为 false,则需要开发者手动关闭,给予了更多灵活控制的空间。

- highWaterMark:这可是控制读取流 “流量” 的关键阀门,它指定了每次读取数据块的大小(单位为字节),默认值通常是 64 * 1024(即 64KB)。合理调整这个值,能根据不同的应用场景优化性能,比如处理大文件时适当增大,减少读取次数;处理小文件或对实时性要求高的场景,适当减小,让数据更快地流动起来。

举个例子,若我们要读取一个本地的文本文件 data.txt,并以 utf8 编码格式处理,代码如下:

const fs = require('fs'); const readStream = fs.createReadStream('data.txt', { encoding: 'utf8' });如此简单的几行代码,便开启了从 data.txt 文件读取数据的通道,数据就像解开了封印,随时准备为程序所用。

3.2.2 监听读取流事件

创建好读取流只是第一步,如何巧妙地捕捉和处理流动的数据才是关键。这里就要用到流的事件监听机制,通过 on 方法为读取流绑定各类事件监听器,如同在河边设置一道道 “关卡”,精准捕获流过的数据。

- data 事件:这是数据流动的 “前沿哨所”,每当有新的数据块从文件中读取出来,就会触发此事件,监听器函数中的参数 chunk 便是这一小段新鲜出炉的数据,我们可以在这个回调函数中即时处理数据,比如进行数据的解析、筛选等操作。例如:

readStream.on('data', (chunk) => { console.log(`接收到数据块: ${chunk}`); // 在这里可以对chunk进行进一步处理,如存储到数组中用于后续拼接等 });- end 事件:标志着读取流的 “终点”,当文件中的数据全部读完,这个事件就会被触发,告知程序数据读取任务圆满完成,此时可以进行一些收尾工作,如关闭相关资源、触发后续流程等。示例如下:

readStream.on('end', () => { console.log('文件读取完毕'); // 可以在此处进行如关闭数据库连接、通知其他模块等操作 });- error 事件:作为 “安全卫士”,时刻警惕着读取过程中的意外情况,一旦出现错误,如文件不存在、权限不足等,该事件就会迅速触发,将错误信息传递给监听器函数,以便开发者及时处理,避免程序崩溃。像这样:

readStream.on('error', (err) => { console.error(`读取文件出错: ${err.message}`); // 可以根据错误类型进行相应的错误提示、日志记录等操作 });通过合理地监听这些事件,我们就能驾驭读取流,有条不紊地处理文件数据,确保整个流程顺畅无阻。以下是一个完整的示例代码:

const fs = require('fs'); const readStream = fs.createReadStream('data.txt', { encoding: 'utf8' }); let dataChunks = []; readStream.on('data', (chunk) => { console.log(`接收到数据块: ${chunk}`); dataChunks.push(chunk); }); readStream.on('end', () => { const completeData = dataChunks.join(''); console.log('文件读取完毕,完整数据:', completeData); }); readStream.on('error', (err) => { console.error(`读取文件出错: ${err.message}`); });在上述代码中,我们创建了读取 data.txt 文件的流,通过监听 data 事件收集所有数据块,在 end 事件中将数据块拼接成完整的字符串并输出,同时也做好了应对错误的准备,全方位保障文件读取的顺利进行。

3.3 创建与使用写入文件流

3.3.1 创建写入流

与读取流相对应,写入流负责将数据精准地输送到文件中。使用 fs.createWriteStream 方法便能开启这一旅程,其语法为 fs.createWriteStream(path[, options]),path 自然是指向目标文件的路径,这决定了数据的 “归宿”。而 options 同样承载着重要的配置信息:

- flags:如同文件的 “访问指令”,常见的有 ‘w’(写入模式,若文件存在则覆盖)、‘a’(追加模式,在文件末尾追加数据,不会覆盖原有内容)等,开发者可根据需求灵活选择,确保数据写入的正确性。

- encoding:设定写入数据的编码格式,与读取流的 encoding 相呼应,保证数据在写入文件过程中的一致性,避免乱码等问题。默认值一般为 utf8,适合大多数文本数据的写入。

- highWaterMark:它控制着写入流内部缓冲区的大小,决定了每次写入数据的最大量,当写入的数据量超过这个阈值时,写入流会有相应的处理机制,后续我们会详细探讨。

例如,要创建一个向 output.txt 文件追加数据的写入流,代码如下:

const fs = require('fs'); const writeStream = fs.createWriteStream('output.txt', { flags: 'a', encoding: 'utf8' });这段代码搭建好了向 output.txt 文件写入数据的通道,后续只要调用相应方法,数据就能按要求流入文件。

3.3.2 写入数据与背压处理

创建好写入流后,使用 write 方法就能驱动数据 “上路”,向目标文件进发。write 方法的返回值暗藏玄机,它像一个信号灯,反映了当前写入流缓冲区的状态:当返回 true 时,意味着缓冲区尚有空间,数据可以继续欢快地写入;而一旦返回 false,则警示开发者,缓冲区已满,此时若强行写入更多数据,可能会引发内存溢出等问题,这就是所谓的 “背压(Backpressure)” 现象。

为了应对背压,Node.js 为我们提供了巧妙的策略。当发现 write 返回 false 时,我们可以暂停读取流(如果有与之对应的读取流协同工作),避免数据的过度积压,就像在交通拥堵时暂时关闭上游的入口,防止道路彻底瘫痪。待写入流的缓冲区通过后续的写入操作腾出空间,触发 drain 事件时,再恢复读取流,重新开启数据的传输,确保整个数据管道的顺畅运行。

以下是一个简单的示例代码,演示如何处理写入数据与背压:

const fs = require('fs'); const readStream = fs.createReadStream('input.txt'); const writeStream = fs.createWriteStream('output.txt'); readStream.on('data', (chunk) => { const canWrite = writeStream.write(chunk); if (!canWrite) { readStream.pause(); writeStream.once('drain', () => { readStream.resume(); }); } }); readStream.on('end', () => { writeStream.end(); });在这段代码中,我们从 input.txt 读取数据,向 output.txt 写入数据。当写入流缓冲区满时,暂停读取流,等待缓冲区排空(drain 事件触发)后再恢复,保障了数据处理的稳定性,有效应对了背压问题,让文件写入操作更加稳健、高效。

3.4 管道流:高效的数据传输

管道流(pipe)是 Node.js 中一种极为高效便捷的数据传输方式,它就像一条精心铺设的 “高速数据通道”,能够自动且智能地连接可读流与可写流,让数据在两者之间如丝般顺滑地流动。使用时,只需简单地在可读流上调用 pipe 方法,并传入可写流作为参数,语法形如 readable.pipe(writable),瞬间就能搭建起这条数据传输的 “高速公路”。

例如,在进行文件拷贝这一常见任务时,传统的方式可能需要我们手动读取源文件数据,再小心翼翼地写入目标文件,过程繁琐且容易出错。而使用管道流,短短一行代码 fs.createReadStream(‘source.txt’).pipe(fs.createWriteStream(‘destination.txt’)) 便能轻松搞定,代码简洁明了,同时性能卓越。它不仅减少了大量的手动数据处理代码,还充分利用了 Node.js 的异步非阻塞特性,自动管理数据的流动节奏,根据系统资源和流的状态动态调整传输速度,确保整个拷贝过程高效、稳定地进行,极大地提升了开发效率,让文件操作变得轻松惬意。对比传统的逐块读写拷贝文件方法,管道流的优势一目了然,是处理大规模数据传输的得力助手。

四、综合案例实战

4.1 大文件分块处理与合并

在实际应用中,我们时常会遇到需要处理大文件的场景,比如大文件的上传、下载,或是对巨型日志文件的分析。由于大文件的体积可能远超系统内存容量,若直接一次性处理,极易引发内存溢出问题。此时,将大文件分块处理便是一种巧妙且高效的解决方案。

假设我们要将一个超大的视频文件上传至服务器,考虑到网络稳定性以及服务器内存限制,我们可以把大文件分割成若干较小的块,逐块上传,上传完成后再在服务器端将这些块合并还原成完整的文件。

以下是一个简化版的大文件分块上传与合并的代码示例:

const fs = require('fs'); const path = require('path'); // 分块大小,这里设定为 1MB const CHUNK_SIZE = 1024 * 1024; // 分块函数 function chunkFile(filePath, chunkDir) { const fileSize = fs.statSync(filePath).size; const fileStream = fs.createReadStream(filePath); let currentChunk = 0; let bytesRead = 0; fileStream.on('data', (chunk) => { const chunkPath = path.join(chunkDir, `chunk${currentChunk}`); const writeStream = fs.createWriteStream(chunkPath); writeStream.write(chunk); writeStream.end(); bytesRead += chunk.length; if (bytesRead >= CHUNK_SIZE) { currentChunk++; bytesRead = 0; } }); fileStream.on('end', () => { console.log('文件分块完成'); }); } // 合并函数 function mergeChunks(chunkDir, outputFilePath) { const chunkFiles = fs.readdirSync(chunkDir).sort((a, b) => a.localeCompare(b)); const outputStream = fs.createWriteStream(outputFilePath); chunkFiles.forEach((chunkFile) => { const chunkPath = path.join(chunkDir, chunkFile); const chunkData = fs.readFileSync(chunkPath); outputStream.write(chunkData); fs.unlinkSync(chunkPath); // 合并后删除分块文件,节省空间 }); outputStream.end(); console.log('文件合并完成'); } const largeFilePath = 'hugeVideo.mp4'; const chunkDirectory = 'chunks'; const outputFile = 'mergedVideo.mp4'; // 先分块 chunkFile(largeFilePath, chunkDirectory); // 模拟分块上传完成后再合并 setTimeout(() => { mergeChunks(chunkDirectory, outputFile); }, 5000);在上述代码中:

chunkFile 函数负责将大文件分块。首先获取源文件大小,接着创建可读流读取文件。每当读取到的数据量达到设定的分块大小(1MB),就将当前数据块写入以 chunkX(X 为序号)命名的文件中,如此循环,直至文件读完,完成分块操作。

mergeChunks 函数用于合并分块文件。它先读取分块目录下的所有文件,并按照文件名排序(确保顺序正确),然后创建一个可写流指向合并后的目标文件。依次读取每个分块文件的内容,写入目标文件,同时删除已合并的分块文件,最终得到完整的合并文件。

这里使用 setTimeout 模拟分块上传过程,实际应用中,分块上传逻辑会在相应的上传处理模块中,且需要考虑网络请求、错误重试等诸多因素。但通过这个示例,大家能清晰了解大文件分块与合并的核心流程。

4.2 多文件整合与数据分析

再来看一个多文件整合分析的案例。假设我们有多个存储着网站用户行为日志的文件,每个文件格式相同,均为每行一条记录,包含用户 ID、操作时间、操作类型等信息。现在需要将这些文件整合到一起,统计每个用户的操作次数,以便进行后续的用户行为分析。

const fs = require('fs'); const path = require('path'); // 存储用户操作次数的对象 const userActions = {}; // 整合并分析文件的函数 function mergeAndAnalyzeFiles(fileDir) { const logFiles = fs.readdirSync(fileDir).filter((file) => path.extname(file) === '.log'); logFiles.forEach((logFile) => { const filePath = path.join(fileDir, logFile); const fileStream = fs.createReadStream(filePath, { encoding: 'utf8' }); fileStream.on('data', (chunk) => { const lines = chunk.split('\n'); lines.forEach((line) => { if (line) { const [userId,, actionType] = line.split(','); userActions[userId] = userActions[userId] || {}; userActions[userId][actionType] = (userActions[userId][actionType] || 0) + 1; } }); }); fileStream.on('end', () => { console.log(`${logFile} 分析完成`); }); }); console.log('所有文件整合分析完成,以下是统计结果:'); console.log(userActions); } const logsDirectory = 'userLogs'; mergeAndAnalyzeFiles(logsDirectory);这段代码实现的功能如下:

首先定义了 userActions 对象,用于存储每个用户不同操作类型的次数统计结果,以用户 ID 为键,每个用户对应的操作次数对象为值,操作次数对象以操作类型为键,出现次数为值。

mergeAndAnalyzeFiles 函数读取指定目录下所有扩展名为 .log 的文件,对每个文件创建可读流逐行读取内容。对于每行数据,按照逗号分隔提取用户 ID 和操作类型,然后在 userActions 中相应位置累加操作次数。当一个文件读取结束,打印该文件分析完成的提示,全部文件处理完后,打印出最终的用户行为统计结果。

通过这个案例,不仅展示了多文件的整合操作,还结合了数据处理与分析,让大家看到 Node.js 文件操作在实际业务场景中的强大作用,能够帮助我们从海量的碎片化数据中提取有价值的信息,为决策提供有力支持。

五、总结与拓展

至此,我们已经全面且深入地探索了 Node.js 中文件及文件流操作的精彩世界。从文件操作的基础 API,如 fs 模块下各种创建、读取、修改、删除文件与目录的方法,让我们能够像熟练的工匠一样精准地操控文件系统;到文件流操作的核心要点,了解流的本质概念以及可读流、可写流、双工流、转换流这四种各司其职的流类型,掌握创建与使用读取、写入文件流的技巧,还有管道流带来的高效数据传输体验,仿佛为我们的数据处理插上了翅膀,使其能够在不同的 “数据源” 与 “目的地” 之间自由翱翔,轻松应对诸如大文件处理、实时数据交互等复杂任务。

通过大文件分块处理与合并,以及多文件整合与数据分析等实战案例,我们更是将所学知识融会贯通,真切感受到这些技术在实际项目中的强大威力,它们能够极大地提升应用性能,挖掘数据价值,为用户带来流畅、智能的体验。

掌握这些 Node.js 文件及文件流操作知识,无疑为前端开发注入了强大动力。无论是优化项目构建流程、处理用户上传下载需求,还是搭建高效的本地数据缓存,都能得心应手。为了更上一层楼,建议大家深入研读 Node.js 的官方文档,那里有最权威、最详尽的知识宝库;同时,积极参与开源社区,探索如 klaw-sync 用于高效遍历文件系统、node-mv 便捷移动文件等优质开源项目,学习他人的智慧结晶,持续提升自己在 Node.js 文件处理领域的造诣,开启更多创新的可能,创造出更加出色的前端应用。愿大家在 Node.js 的学习道路上不断精进,收获满满!

- error 事件:作为 “安全卫士”,时刻警惕着读取过程中的意外情况,一旦出现错误,如文件不存在、权限不足等,该事件就会迅速触发,将错误信息传递给监听器函数,以便开发者及时处理,避免程序崩溃。像这样:

- end 事件:标志着读取流的 “终点”,当文件中的数据全部读完,这个事件就会被触发,告知程序数据读取任务圆满完成,此时可以进行一些收尾工作,如关闭相关资源、触发后续流程等。示例如下:

- data 事件:这是数据流动的 “前沿哨所”,每当有新的数据块从文件中读取出来,就会触发此事件,监听器函数中的参数 chunk 便是这一小段新鲜出炉的数据,我们可以在这个回调函数中即时处理数据,比如进行数据的解析、筛选等操作。例如: